Помните времена, когда рекомендованные розничные цены у официальных реселлеров видеокарт казались грабежом? Многие воротили носом и шли на серый рынок, чтобы сэкономить несколько тысяч рублей. Именно тогда в нашем блоге выходила статья “Crysis на максималках, или зачем серверу видеокарта”.

Сейчас же времена тяжелые, купить видеокарту по РРЦ почти невозможно, а цены в серых магазинах, у скальперов и перекупщиков в несколько раз выше. Ну а поскольку видеокарты не продают, а показывают, то я решил пойти от обратного — почему серверу не нужна дискретная видеокарта?

В этой статье мы пройдёмся по iGPU; обсудим, чем отличаются GPU, CPU и APU; узнаем, из-за чего не все Xeon’ы разрабатывались для серверов и ещё много интересного.

Осторожно! Лонгрид!

Появление

Первые компьютеры, например ABC или ENIAC, не умели работать с графикой, и трудились исключительно над математическими расчётами. Однако уже в 50-ые годы с помощью программирования памяти и устройств вывода энтузиасты создавали узоры из множества ламп накаливания. И с того момента началась история компьютерной графики.

На Википедии первыми в истории графическими адаптерами числятся разработки от IBM 1981 года, однако в 1977-1978 годах Matrox, компания из Канады, уже разработала своё решение —ALT-256 для шины S-100 bus.

Карта состояла из одной платы, 38 TTL микросхем и 16 микросхем оперативной памяти DRAM TMS4027 (по 4 килобита каждая). Эта малышка могла генерировать изображение в 256х240 видимых пикселей на составной (композитный) монитор. Устройство карты не позволяло отображать оттенки серого: пиксель либо включался, либо выключался — всё.

Изображение, выведенное с помощью ALT-256.

Решением выступало объединение трёх карт: для каждой выделялся один из цветов палитры RGB, тогда получалось отображать до 8 оттенков серого на черно-белых мониторах и до 8 цветов на цветных (красный, жёлтый, зелёный, голубой, синий, фиолетовый, белый и чёрный). И всё бы ничего, но цена составляла $395, что по нынешним меркам больше $1500. Итого $4500 за немонохромную картинку — примерно как RTX 3090 у скальперов. Берём?

Первые видеоадаптеры от IBM были выпущены в 1981 году. Один назывался MDA (англ. Monochrome Display Adapter), а другой — CGA (англ. Color Graphics Adapter).

MDA — 720х350, только текстовый режим до 25 строк. Изображение, выдаваемое MDA.

CGA — 320х200, Глубина цвета в текстовом режиме — 16 цветов, в графическом режиме — 4 цвета. 640х200 — монохромный режим.

Браузер Arachne в монохромном режиме 640×200.

Sim City (Maxis, 1989) в монохромном режиме 640×200.

Принц Персии (1990) в графическом режиме 320х200

Кстати, подключение к совместимым мониторам, например IBM 5153, происходило через 4-битный цифровой (TTL) интерфейс RGBI.

Слева направо: IBM 5151, IBM 5153, IBM 5154.

Чтобы подключиться к NTSC-совместимому телевизору по тюльпанам нужен отдельный радиочастотный модулятор. MDA и CGA, разумеется, интегрированными 3D-ускорителями не были, но отражали надвигающиеся изменения в отрасли. Кстати, обе карты можно было использовать одновременно, так как функционал у них различался.

Время шло, запросы на графику росли, а видеоигры набирали всё большую популярность и сулили огромные прибыли вендорам и разработчикам. На рынке, как капли на лобовом стекле, начали появляться новые компании:

- В декабре 1984 года была основана Chips and Technologies или C&T (Чипсы Чипы и Технологии). В 1997 году компанию поглотила Intel.

- В 1985 году появилась ATi. Её основателями стали китайские эмигранты Квок Йен Хо, Ли Лау и Бенни Лау, перебравшиеся в Канаду. Начала ATi со звуковых карт и только в 1991 году выпустила первый видеоускоритель — Mach 8, клон IBM 8514/A. Сейчас ATi — это графическое подразделение AMD. С 2010 прежнее название не используется.

- В январе 1989 года Диосдадо Банатао и Рональдом Иара основали S3 Graphics. Этой компании первой удалось разработать однокристальный ускоритель графического интерфейса. До продажи VIA Technologies в основном производила недорогие чипы для отображения 2D-графики. В 2000-году из-за неудач на рынке 3D пришлось продать активы. В 2011 компанию выкупила HTC.

- В 1993 году появилась Nvidia. Её основали один из руководителей компании по производству интегральных схем LSI Logic — Дженсен Хуанг, а также недовольные работой в Sun Microsystems инженеры — Крис Малаховски и Кёртис Прэм.

- В 1994 году была основана 3dfx Interactive, первый продукт которых (Voodoo Graphics) получил успех в аркадных автоматах. История этой компании напоминает спичку: 3dfx ярко начала, де-факто основав рынок 3D-ускорителей, разработала технологию SLI, но обанкротилась в 2002 году, а активы выкупила Nvidia. Оставшиеся без поддержки пользователи могли за ограниченное время обменять продукт 3dfx на сопоставимый от Nvidia.

При этом старички вроде Matrox и IBM никуда не делись. Высокая конкуренция способствовала бурному развитию и появлению большого количества продуктов.

Чего только стоит профессиональный контроллер IBM PGC, выпущенный в 1984 году. Разрешение 640х480, 256 цветов, 320 Кб оперативной и 68 Кб постоянной памяти, собственный процессор Intel 8088 и обратная поддержка режимов CGA. Всего за $3000 (эквивалентно $7700 в 2022 г.) + монитор IBM 5175 за $1300 ($3340 в 2022 г.), так как ускоритель работал только с ним. Игры на этом чуде техники не запускали, ведь его основная функция — работа с САПР и Autocad 2.5.

На изображениях видно, что IBM PGC состояла из трёх отдельных плат.

Две полноразмерные ISA (Industry Standard Architecture) платы и уменьшенная между ними. Скреплялось это дело болтами.

Возможно, кто-то из вас помнит ускорители S3 Trio3D и Trio3D/2X, анонсированные в ноябре 1997 года. Своё название карты получили из-за использования трёх компонентов — тактового генератора, ядра и преобразователя RAMDAC (random-access memory digital-to-analog converter). Карты продавались в бюджетном сегменте, но поддерживали наложение текстур, 3D-ускорение, метод тонирования Гуро, работу с оверлеями, билинейную и трилинейную фильтрацию и многое другое.

Характеристики S3 Trio3D и Trio3D/2X:

- Разрешение до 1600×1200 и 85 Гц;

- До 8 Мб SDRAM или SGRAM;

- Шина AGP и AGP 2X соответственно;

- D-SUB 15-PIN (VGA).

Ещё одна карта, заслуживающая внимания — Nvidia RIVA TNT2, вышедшая в 1999 году. Карта опережала ближайшего конкурента в лице Voodoo3 от 3dfx. TNT2 позволяла не только выводить настоящую 32-битную картинку в 3D, но и имела два конвейера одинарного текстурирования, против одного двойного у Voodoo3. Если простыми словами, то в играх, где накладывалась одна текстура на поверхность объекта, TNT2 была быстрее. 32-битный рендеринг стал важным преимуществом, когда в играх стали всё чаще использовать технологии альфа-композитинга и многопроходных эффектов.

Характеристики были следующими:

- Разрешение до 2046 x 1536;

- 32 Мб VRAM;

- Шина AGP 4X;

- D-SUB 15-PIN (VGA)

В эти годы происходили действительно грандиозные события: технологический бум, головокружительный рост рынка потребительской электроники, война Windows и Mac. Эпоха увлекательная, в неё можно погрузиться, как в зыбучие пески, поэтому переместимся немного дальше.

Intel: лучше поздно, чем никогда

В 1997-ом Intel, оценив положение дел, покупает компанию C&T, чтобы запустить производство собственных графических чипов. Планы у компании наполеоновские — ворваться на бурно развивающийся рынок и возглавить его. Всего через год они выпускают первый 3D-ускоритель под собственным брендом — Intel 740. На ней и закончим прогулку по нашему палеонтологическому музею. В конструкции было два чипа для раздельной обработки графики и текстур. Также ускоритель работал через 32-разрядную системную шину AGP (Accelerated Graphics Port), разработанную Intel в 1996 году. Версия для PCI также выпускалась.

Характеристики:

- Разрешение: 1280×1024 16 бит, 1600×1200 8 бит, 160 Герц;

- Фрейм-буфер — 4 или 8 Мбайт, память на PCI-вариантах — 8 или 16 Мбайт, чипы SGRAM или SDRAM;

- Шина: AGP или PCI;

Intel 740

Различные версии шины AGP

Но дискретная видеокарта от Intel не выдержала конкуренции с продуктами Nvidia, ATi и 3dfx. Последняя попытка по выпуску дискретных видеокарт была предпринята в 1999 году, тогда анонсировали i752 и i754. Первую выпускали ограниченно, а вторую отменили.

Что ж, посмотрим, получится ли у Intel вторая попытка в 2022 году. Их дискретный 3D ускоритель линейки Arc Alchemist на GPU DG2-512EU в предварительных тестах обгоняет GeForce RTX 3070 Ti и RX 6700 XT. Учитывая тотальный дефицит, есть все шансы закрепиться на рынке.

Зато предыдущие наработки i752 и i754 пригодились в чипсетах Intel 810 и Intel 815 с интегрированной графикой. Материнские платы с собственными видеоускорителями получились недорогими и энергоэффективными, но с рядом очевидных недостатков:

- Относительно невысокая производительность;

- Если нужно обновить графический ускоритель, то придётся менять и материнскую плату;

- Собственной видеопамяти у таких чипов не было, так что использовалась RAM. Из-за этого общая производительность ПК падала.

В таком виде интегрированная графика от Intel существовала в сериях Extreme Graphics и Graphics Media Accelerator (GMA), пока северный мост в чипсетах не упразднили — его функции взял на себя CPU и частично PCH (Platform Controller Hub). Как вы уже догадались, графический процессор стал частью CPU.

Архитектура Intel 5-ого поколения.

Так, в 2010 году, началась история Intel HD Graphics — интегрированных в CPU графических процессоров (iGPU). Строго говоря, CPU с графикой на одном кристалле правильнее называть APU (Accelerated Processor Unit). Однако в первых решениях Intel на микроархитектуре Westmere графика находилась на отдельном кристалле, изготовленном по старому техпроцессу (45 нм против 32 нм у процессора), такие многочиповые сборки называются MCM (Multi-chip module, многокристальный модуль).

Начиная с микроархитектуры Sandy Bridge, решения стали настоящими APU. И даже тогда Intel продолжила называть свои разработки по-старому — CPU. К слову, технология развивается по сегодняшний день и будет реализована в 12-ом поколении процессоров Alder Lake.

С линейкой интегрированной в CPU графики от Intel можно ознакомиться по ссылке. Моделей за годы было выпущено очень много, поэтому рассматривать их все в статье бессмысленно.

Но есть одна интересная особенность: некоторые серверные процессоры Xeon оснащаются графическим процессором с приставкой “P” (Professional).

Например:

HD Graphics 3000: Core i3-21×5, Core i5-2405S, Core i5-2500K, Core i7-2x00K;

HD Graphics P3000: Xeon E3-12×5.

Почему так? И зачем серверному процессору интегрированная графика? Ведь большинство “Зионов” вообще не имеют никакой графики, а серверы работают.

Ответ очень прост — графические ядра “P” в процессорах получили сертификаты от CAD, BIM и других профессиональных приложений: AutoCAD, Revit, Inventor, Adobe Photoshop, 3Ds Max и т.д.

Получается, что сама Intel позиционирует процессоры Xeon с iGPU как решения для рабочих станций, чтобы без дискретных видеокарт можно было работать с профессиональным софтом.

Вот что пишет Intel на своем сайте про E-серию:

“Процессоры Intel Xeon E обеспечивают необходимую производительность и передовые технологии безопасности для серверных решений начального уровня, профессиональных рабочих станций и безопасных облачных сред. Доступны с интегрированной UHD-графикой Intel”.

Очевидно, что “Зионы” серии E без iGPU предназначены для серверов, а остальные (V4, V5) — решения для рабочих станций.

У Intel есть ещё одна линейка — Xeon W, которую представили в 2019 году вместе с Mac Pro. Эти процессоры изначально создавались для рабочих станций, в каждом есть встроенная графика, а “W” можно толковать как “Workstation”. Они не поддерживают Optane DC Persistent Memory, не работают в многосокетных режимах, в Speed Select и Resource Director (RDT). Но есть опции с литерой “M”, которые поддерживают больше памяти (до 2 Тб) и коррекцию ошибок во всех моделях, что немного приближает их к серверным решениям.

“Платформы с процессорами Intel Xeon W — это лучшие платформы для творческих специалистов, обеспечивающие выдающуюся производительность, безопасность и надежность, а также расширенные возможности для VFX, 3D-рендеринга, сложных задач 3D-CAD, а также для разработки ИИ-приложений и пограничных развертываний”.

Вот и получаем, что многие привыкли называть Intel Xeon серверными процессорами, но не все они являются таковыми, а iGPU выступает в роли лакмусовой бумажки. Да, это никак не мешает устанавливать их в сервер и нормально использовать, но нужно предварительно оценить, насколько такое решение будет релевантным с точки зрения стоимости и функционала.

Что такое видеоадаптер

Видеокарта (видеоадаптер, графический ускоритель, видеоускоритель) – орган ПК, который, говоря простым языком, преобразует информацию в памяти компьютера или самого адаптера в изображение, «картинку» на мониторе. Состоит она из нескольких основных частей: графического ядра, видеоконтроллера, постоянного запоминающего устройства (ПЗУ), оперативной памяти (видео-ОЗУ), цифро-аналогового преобразователя (ЦАП), разъема и системы охлаждения.

Графическое ядро – процессор, производящий все вычисления показываемой «картинки» на экране и обработку команд при построении графики. Является основным компонентом в плате, т. к. более высокие значения частоты процессора увеличивают её мощность и скорость обработки. В нынешнее время новые видеоускорители обладают значениями, которые превосходят центральные процессоры по производительности, обеспечивая хорошим быстродействием сам ПК. А обладая двумя ядрами, которые работают независимо друг от друга, могут выводить изображение на несколько дисплеев одновременно. Частота процессора, в зависимости от видеоускорителя, варьируется от 500 МГц до 1600 МГц.

Видеоконтроллер – микросхема, отвечающая за формирование изображения в памяти и дальнейшего её выведения на экран.

ПЗУ – память, хранящая основные элементы данных (BIOS, шрифты) для предварительной инициализации и управления видеокартой до загрузки операционной системы компьютера.

Видео-ОЗУ – компонент, предназначенный для хранения данных изображений, которые постоянно изменяются и требуют к ним быстрого доступа. За счёт этого память видеокарты обладает высокой частотой работы и скоростью пропуска данных к ней. Существует несколько типов памяти, которые менялись по классу, вырастая в скорости и частоте начиная с DDR и заканчивая GDDR 5. Объем варьируется от 2 Гб до 64 Гб в одной планке.

ЦАП предназначен для выведения на экран монитора изображения, образуемого видеоконтроллером. В зависимости от типа ЦАП, может выводиться от 16,7 млн до более 1 млрд цветов.

Разъёмы соединяют видеокарту и монитор для показа картинки. Используются в различных интерфейсах, от аналогового VGA (ныне устарел) до цифрового DVI, DP и HDMI.

Система охлаждения же поддерживает температуру ядра и памяти в пределах допустимого, не позволяя перегреваться.

Советуем Вам также ознакомиться с отличиями интегрированной видеокарты от дискретной.

AMD: подержите моё пиво

Разумеется, не только Intel двигалась в направлении интеграции графики в CPU. Собственные разработки были также у AMD и IBM/GlobalFoundries.

AMD начала работу сразу после покупки ATi в 2006 году. Разработка велась долго — от идеи совместить два кристалла в одном корпусе (как это сделала сначала Intel) пришли к тому, что мы имеем сейчас. Первые однокристальные APU, созданные по 32-нанометровому техпроцессу, увидели свет в 2011 году и получили название “Fusion”. И в отличие от Intel, маркетологи AMD взяли на вооружение аббревиатуру APU.

Внутри линейки AMD APU изначально было выделено 3 серии:

C (Ontario) — наименее мощная (от 1 ядра с частотой 1.2 ГГц до 2 ядер с 1-1.33 ГГц);

E (Zacate) — средняя по мощности (от 1 ядра с частотой 1.3 ГГц до 2 ядер с 1,65 ГГц

A (Llano) — самая мощная (от 2 ядер с частотой 1,9-2,5 ГГц до 4 ядер с 2,9 ГГц).

Микроархитектура AMD APU Llano на примере старшей модели.

Если говорить о всей блок-схеме платформы AMD (на примере A-серии), то она называется Lynx и выглядит так: APU Llano + FCH (Fusion Controller Hub).

Не смотря на то что к интегрированной графике обычно относятся как к маломощному решению, PS5 и Xbox Series X (Past-Gen тоже) используют именно APU от AMD. В приставках последнего поколения поставили графический процессор Radeon Navi, выполненный по архитектуре RDNA2, но с разной реализацией.

Вы только посмотрите, сколько места на кристалле занимает GPU в Xbox Series X. Это позволяет выдавать впечатляющие 12,2 TFLOPS.

Что касается актуальной интегрированной графики (или её отсутствия) в процессорах AMD, то разделение кажется логичнее и проще, чем у Intel. Рассмотрим на примере 7-нанометровой микроархитектуры Zen 2.

Процессоры на базе Zen 2:

- Линейка Ryzen, включающая в себя решения для дома и офиса, ноутбуков, игровых ПК и рабочих станций (Threadripper). Графика есть не во всех моделях.

- Линейка EPYC — серверные процессоры, которые не имеют встроенной графики во всех моделях.

- Линейка Embedded — встроенные процессоры, созданные для информационных киосков, киосков продаж, промышленности, медицины, ТВ-приставок, тонких клиентов, медиасерверов и т.д.

Процессоры микроархитектуры Zen 2 делятся на APU и CPU следующим образом:

| Применение | Позиционирование | Встроенная графика |

| Настольные CPU | Начальный уровень: Ryzen 5 3xxx | — |

| Средний уровень: Ryzen 7 3xxx | — | |

| Старший уровень: Ryzen 9 3xxx | — | |

| HEDT (High-End Desktop) и рабочие станции: Ryzen Threadripper 3xxx | — | |

| Серверные CPU | Односокетные: EPYC 7xxxP | — |

| Двухсокетные: EPYC 7xxx | — | |

| Мобильные APU | Начальный уровень: Ryzen 3 4xxx | + |

| Средний уровень: Ryzen 5 4xxx; Ryzen 7 4xxx (8 потоков) | + | |

| Старший уровень: Ryzen 7 4xxx (16 потоков); Ryzen 9 4xxx | + | |

| Lucienne (5000 series): Ryzen 3 5300U; Ryzen 5 5500U; Ryzen 7 5700U. | + | |

| Настольные APU | Начальный уровень: Ryzen 3 4xxxG | + |

| Средний уровень: Ryzen 5 4xxxG | + | |

| Старший уровень: Ryzen 7 4xxxG | + | |

| Embedded процессоры | Radeon Vega 6: V25xx | + |

| Radeon Vega 7: V27xx | + |

Всё настолько логично и разложено по полочкам, что на месте AMD я именно такую таблицу и выложил бы на сайт:

- У настольных процессоров есть варианты с интегрированной графикой и без — выбирайте под свои задачи и бюджет;

- Серверные CPU и CPU для рабочих станций разделены как технически, так и по названиям, чтобы никакой путаницы не возникало. Интегрированную графику убрали за ненадобностью;

- Все процессоры для ноутбуков оснащены интегрированной графикой.

Интересно, что с 2012 по 2016 год включительно AMD была убыточной компанией и стремительно теряла долю рынка и сокращала персонал.

В 2013 году спад спроса на рынке ПК коснулся и Intel, но они закончили финансовый год с прибылью, хоть и упавшей на 25%.

В 2017-2018 годах AMD смогла выйти из затяжного пике. Их спасли отличные продажи процессоров на архитектуре Zen х86.

Преимущества встроенных решений в играх

Итак. Для чего же нужна интегрированная карта и в чем заключаются ее отличия от дискретной.

Постараемся сделать сравнение с пояснением каждой позиции, сделав все максимально аргументировано. Начнем, пожалуй, с такой характеристики как производительность. Рассматривать и сравнивать будем наиболее актуальные на данный момент решения от Intel (HD 630 c частотой графического ускорителя от 350 до 1200 МГц) и AMD (Vega 11 с частотой 300-1300 Мгц), а также преимущества, которые дают эти решения.

Начнем со стоимости системы. Встроенная графика позволяет неплохо сэкономить на покупке дискретного решения, вплоть до 150$, что критически важно при создании максимально экономного ПК для офисного и домашнего использования.

Частота графического ускорителя AMD заметно выше, да и производительность адаптера от красных существенно выше, что говорит о следующих показателях в тех же играх:

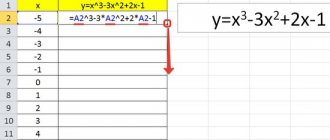

| Игра | Настройки | Intel | AMD |

| PUBG | FullHD, низкие | 8-14 fps | 26-36 fps |

| GTA V | FullHD, средние | 15-22 fps | 55-66 fps |

| Wolfenstein II | HD, низкие | 9-14 fps | 85-99 fps |

| Fortnite | FullHD, средние | 9-13 fps | 36-45 fps |

| Rocket League | FullHD, высокие | 15-27 fps | 35-53 fps |

| CS:GO | FullHD, максимальные | 32-63 fps | 105-164 fps |

| Overwatch | FullHD, средние | 15-22 fps | 50-60 fps |

Как видите, Vega 11 – лучший выбор для недорогих «игровых» систем, поскольку показатели адаптера в некоторых случаях доходят до уровня полноценной GeForce GT 1050. Да и в большинстве сетевых баталий она показывает себя прекрасно.

На данный момент с этой графикой поставляется только процессор AMD Ryzen 2400G, но он определенно стоит внимания.

Другие виды графики

Из истории видно, что первоначально графика была дискретной — отдельная плата, на которой распаяны графический процессор и видеопамять. Де-факто — компьютер в компьютере. И на данный момент этот вид остаётся самым производительным и одновременно дорогим.

Следом появилась iGPU, графика с разделяемой памятью. Примеры: Intel 740 и Intel HD Graphics и Vega от AMD. Собственной видеопамяти в таких графических адаптерах как правило нет, вместо этого используется RAM. Популярное решение для компактных и офисных ПК, ноутбуков, а также для игровых приставок.

А что интересного есть ещё?

Инженеры — люди увлеченные и зачастую творческие, поэтому разрабатывали и другие виды графики. Толчком к реализации новых идей стало появление шины PCIe в 2002 году.

Nvidia, в команде с другими вендорами, разработала стандарт MXM (Mobile PCI Express Module), который должен был решить проблему модификации графической части ноутбуков. Модули MXM можно менять по мере необходимости без полного разбора устройства — это некая разновидность привычных нам дискретных видеокарт, но без собственного активного охлаждения.

Ещё одной интересной технологией является гибридная графика. Так как APU начали набирать всё большую популярность, во многих ПК графические ядра простаивают без дела — всю нагрузку на себя берёт видеокарта. Из-за этого даже стали появляться удешевлённые версии CPU без iGPU, например процессоры Intel с литерой “F”. Однако есть способы задействовать одновременно видеокарту и интегрированную графику. Например, AMD на своём сайте заявляет, что: “Двойная графика AMD Radeon представляет собой инновационную технологию, используемую только на платформах AMD, благодаря которой гибридные процессоры AMD и определенные дискретные графические карты AMD Radeon могут работать вместе. Благодаря такому сочетанию платформа обеспечивает потрясающее качество и производительность, лучшие чем у каждого из устройств по отдельности”.

Похожая технология есть и у Nvidia, называется она — Optimus. Когда нагрузка низкая, используется iGPU в процессоре, когда нагрузка высокая, в работу включается дискретная графика со словами: “Сейчас батя разберётся”.

Конечно, у двойной графики от AMD и Nvidia есть множество нюансов и компромиссов, но получить и производительность и увеличенное время автономной работы с их помощью можно.

Ещё одна технология, заслуживающая внимания, это внешняя видеокарта или eGPU (External Graphics Processing Unit).

Ноутбуки на заре своего появления не могли похвастаться мощной графикой. Это сейчас можно приобрести игрового монстра с RTX 3080 на борту, но раньше на лэптопах преимущественно работали с нетребовательными офисными приложениями. Но потом стало очевидно, что PCIe позволяет создать интерфейс для подключения внешней графики, решающей эту проблему.

Ну и закончим на гении китайской инженерной мысли.

Встречайте — база ZA-KB1650 от Zeal-All со встроенной дискретной (простите за каламбур) видеокартой GeForce GTX 1650. На кой чёрт они распаяли дискретную видеокарту прямо на материнской плате, мы никогда не узнаем. Но это явно продукт под определённую задачу.

Выделенная графика также использует больше мощности

Есть причина, по которой у специализированных видеокарт есть встроенные вентиляторы: они сильно нагреваются.

Испытания показывают, что при большой нагрузке Titan Xp может достигать 185 градусов по Фаренгейту или более. Это в дополнение к аналогичным уровням тепла, выделяемого процессором и другими компонентами внутри компьютера. Важно, чтобы ваш компьютер не перегревался .

Для сравнения, процессор Intel Core M со встроенной графикой может достигать максимального значения в 160 градусов во время игры. Там нет вентилятора вообще, и он использует гораздо меньше энергии.

Тесты показывают, что графическая производительность на этой установке сравнивается с выделенной картой, которой несколько лет. Но если вы не геймер и цените энергоэффективность, то это, вероятно, лучший выбор.

Вернёмся к нашим серверам

Надолго в прошлом тысячелетии задерживаться не будем. Первые серверные процессоры под брендом Xeon компания Intel выпустила в 1998-ом году. Дебютным продуктом стал Pentium II Xeon Processor.

Также Intel с 2001 года выпускала процессоры семейства Itanium на архитектуре IA-64 — результат совместной разработки с HP. Дальнейшие разработки решили закончить на 32-нанометровых Itanium 9700 (Kittson), представленных в 2022 году.

Первый Itanium.

Первой попыткой AMD выйти на серверный рынок можно назвать процессор AMD Athlon MP, разработанный на ядре Palomino в 2001-году. Двумя годами позже AMD (в партнёрстве с IBM) представила серверные процессоры Opteron. Данная линейка завершилась на модели Opteron A1170 в 2016-ом, а уже в 2022 году были представлены новые EPYC, актуальные и сегодня.

На процессоре AMD Opteron 246 стоит маркировка 2001-его года, хотя выпущен он в 2003-ем. Может кто-то из читателей знает, почему?

Выше я уже затронул тему встроенной графики в серверных процессорах. “Зионы” с iGPU позиционируются Intel как решения для рабочих станций. При этом HD Graphics только со второго поколения (2011-ого) начала устанавливаться в семейство Xeon.

AMD вообще разделила линейки, сделала серверные Opteron и EPYC, а также Threadripper для рабочих станций без iGPU, чтобы не вызывать путаницу у покупателей.

Получается, что микропроцессорные вендоры не встраивают графику в CPU для серверов, а вендоры серверов поставляют своё оборудование без дискретной графики по-умолчанию. И напрашивается вопрос: “Как с этим работать?”

На форуме Dell я наткнулся на вопрос одного бедолаги, купившего сервер Dell R330 с процессором Intel Xeon E3-1225 v5, в котором есть iGPU Intel HD P530. Ему нужно было запустить какой-то софт кодирования и декодирования видео, работающий с технологией Intel QuickSync Video, но встроенная графика оказалась отключеной.

На что он получил ответ, что чипсет не поддерживает встроенную в CPU графику.

Так что парню пришлось либо установить дискретную графику через плату расширения, либо довольствоваться интегрированной в чипсет графикой Matrox G200 — чего явно недостаточно под его задачу. Этот видеоускоритель был разработан компанией Matrox аж в 1998 году(!) и выглядел так.

| Интересный факт: Раньше радиаторы зачастую окрашивали в черный цвет, хотя лишний слой краски в теории мешает тепловыделению. Всё из-за закона излучения Кирхгофа, который гласит: “Отношение излучательной способности любого тела к его поглощательной способности одинаково для всех тел при данной температуре для данной частоты и не зависит от их формы и химической природы”. Позже, с появлением активного охлаждения, решили пренебречь излучательной способностью. |

Сейчас Matrox G200 сильно потерял в размерах и распаивается на материнской плате. Версия в современным серверах (Matrox G200eW) имеет в два раза больше памяти SDRAM — целых 16 Мб И пускай этот динозавр безнадежно устарел, его хватает, чтобы отображать консоль и даже GUI в серверах. А большего и не надо. Кстати, когда-то на нём можно было даже поиграть в легендарные Half-Life, Quake II, Sin и Heretic II.

Не нагружая CPU лишней графической частью, пользователи и вендоры получают следующие преимущества:

- Уменьшается стоимость процессора, а их может быть несколько;

- Меньше энергопотребление и требования по TDP;

- Можно уменьшить размеры кристалла или увеличить количество транзисторов на нём.

Выделенные графические ноутбуки существуют

Вы можете получить ноутбуки с выделенными видеокартами, но ваши возможности более ограничены. Компромиссы — больший размер и более высокая цена.

Интегрированные графические ноутбуки, такие как Dell XPS 13 или Acer Swift 7, имеют толщину менее половины дюйма. Сравнимая модель Dell добавляет около четверти дюйма к глубине. Asus ZenBook 13 с диагональю 0,55 дюйма считается самым тонким ноутбуком с выделенной графикой.

Большинство ноутбуков с дискретной графикой — это либо игровые ноутбуки, либо высококлассные машины, предназначенные для профессиональных пользователей. Большой размер также означает, что 13-дюймовые модели встречаются редко, с 15-дюймовыми и выше более распространенными.

Не хотите идти на компромисс по размеру, но хотите максимально возможную производительность? Существует третий, менее известный выбор: внешний графический процессор

Немного о разнице CPU и GPU

Серверные CPU — это мощные универсальные комбайнеры. Но в CPU значительно меньше ядер: единицы и десятки против тысяч в GPU. Например, AMD Threadripper 3990X имеет 64 ядра и будет выполнять меньше команд за такт, чем Nvidia RTX 3090 с 10496 ядрами CUDA, но зато ядра устроены намного сложнее и способны выполнять длинные инструкции с высокой точностью.

Если сравнить рендеринг на CPU и GPU, то окажется, что CPU выдаст более сложную картинку, с меньшим количеством шумов, но скорость будет не такой впечатляющей. Чтобы выполнить аналогичные по сложности расчёты, GPU придётся разбивать длинную инструкцию на маленькие и простые. Обработка будет быстрее, но нюанс в том, что не все инструкции можно разбить, а потому рендеринг на GPU ограничен в возможностях.

При сравнении рендеринга в лоб получим следующее:

| Параметр | CPU | GPU |

| Скорость | — | + |

| Сложность | + | — |

| Качество | + | — |

| Рендеринг в реальном времени | —* | + |

| Стоимость | — | + |

*CPU могут рендерить в реальном времени, но делают это несравнимо хуже.

На видео с 10-ой минуты можете убедиться в этом своими глазами. Crysis 1, запущенный на AMD Threadripper 3990X идёт с очень низким FPS на минимальных настройках. Напоминаю, что это процессор без встроенной графики для рабочих станций, у которого 64 ядра, 128 потоков и цена в 3990 долларов.

Вроде бы перевес в сторону GPU, но когда речь о дорогостоящих проектах, где в приоритете качество — всё же выбирают CPU. Поэтому серверы без дискретной графики вполне могут брать на себя следующие задачи: рендеринг, видеоконвертирование, обработка фото, видеоредактирование, создание видеоконтента, архивирование, научные расчёты и многое другое. И обработку 2D-интерфейса для передачи на тонкие клиенты CPU осилит — не сомневайтесь.

При создании анимационных фильмов, например “Город героев” от Disney, используются невероятные рендер-фермы с 55000 и более процессорами. Подобная инфраструктура создаётся, чтобы реализовать технологии параллельного рендеринга. Это позволяет значительно ускорить обработку сложной графики и/или визуализировать крупные массивы данных,

Зачем новое, если старое справляется

Все серверы по-умолчанию комплектуются интегрированными маломощными GPU, способными обеспечить базовый функционал. А если нужны дополнительные ресурсы, то всегда есть возможность модификации и расширения.

Сервер — это в первую очередь бизнес-инструмент, а потому вендоры используют проверенные временем решения, которых достаточно для поставленных задач. Это не перегружает продукт ненужным функционалом и не удорожает его в производстве. Если серверам для нормальной работы когда-то понадобится мощная графика, можете не сомневаться — конкуренция и здравый смысл мгновенно заставят производителей установить её. Возможно, в процессор, а возможно — в чипсет. Но сейчас справляются даже разработки 1998 года.

Вместо заключений хочется сказать, что Matrox G200 в своё время был потрясающим передовым видеоускорителем. Возможно, лет так через 20, какая-нибудь RTX 3090 безнадежно устареет и будет использоваться в виде маленького чипа, чтобы отображать простенький (по меркам будущего) GUI холодильника или мультиварки.

А пока будем мечтать об адекватных ценах на дискретную графику.

Как сравнивать видеочипы

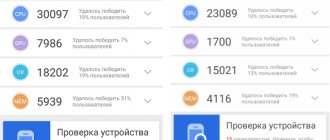

Их сравнение на глаз довольно затруднительно, поэтому рекомендуем вам заглянуть на эту страничку, где можно увидеть информацию обо всех интгегрированных решениях Intel, и эту, где можно посмотреть рейтинг производительности видеоадаптеров и их результаты в бенчмарках. Чтобы узнать о том, какая графика стоит нужном вам процессоре, зайдите на сайт Intel, ищите ваш процессор по фильтрам, а затем загляните в графу «Встроенная в процессор графика».